Zuckerberg quiere crear una «súper IA»: ¿trabajará por nosotros o nos aniquilará?

[ad_1]

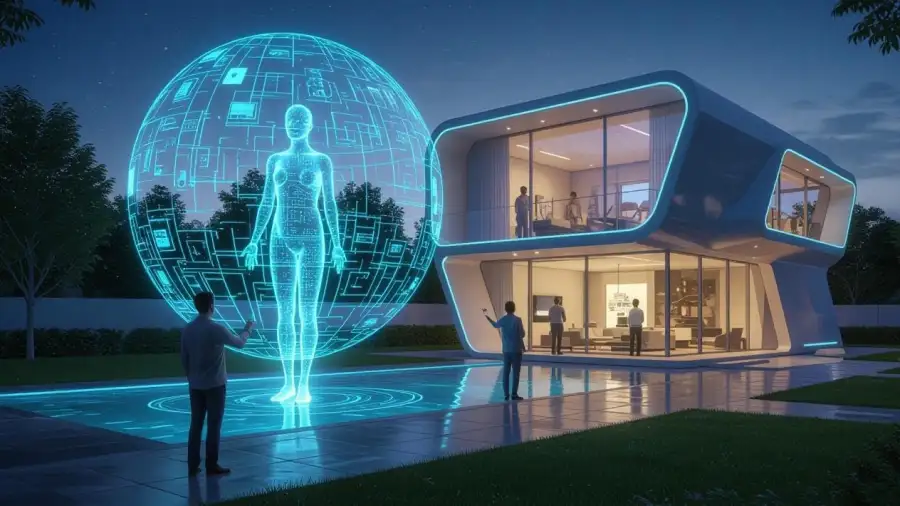

Mark Zuckerberg está destinando miles de millones de dólares para renovar su estrategia de inteligencia artificial (IA) con un nuevo equipo de investigadores que se dedicarán exclusivamente a crear una «superinteligencia personal«, un hipotético sistema de inteligencia artificial que excede los poderes del cerebro humano y, según se proyecta, podría resolver los grandes problemas de la humanidad.

El CEO de Meta –casa matriz de Facebook, Instagram y WhatsApp-, dijo a finales de julio a los inversores de su empresa que su modelo de inteligencia artificial más poderoso que el cerebro humano mejorará «casi todos los aspectos de lo que hacemos» y servirá como una herramienta personal para que los seres humanos creen «una nueva era de empoderamiento individual», agregó.

La era del «soft power» de la inteligencia artificial

Esto no les gusta a los autoritarios

El ejercicio del periodismo profesional y crítico es un pilar fundamental de la democracia. Por eso molesta a quienes creen ser los dueños de la verdad.

Según explicó Zuckerberg, su objetivo es crear una IA «fundamentalmente más inteligente que los humanos» que ayude a los individuos a lograr sus metas personales, crear y conectar de maneras innovadoras. «Creo que si la historia es una guía, entonces un papel aún más importante será cómo la superinteligencia empodera a las personas para que sean más creativas, desarrollen la cultura y las comunidades, se conecten entre sí y lleven vidas más plenas», dijo Zuckerberg.

Zuckerberg explicó que la principal forma en que las personas interactuarán con la superinteligencia será a través de los anteojos inteligentes de Meta, que tienen cámaras y software que pueden grabar y procesar videos. Pero, salvo por imaginar anteojos inteligentes interactivos que «verán lo que vemos, escucharán lo que escuchamos» y se convertirán en nuestros «dispositivos informáticos principales«, el millonario fue notablemente escueto en detalles.

Los gigantes tecnológicos, en guerra virtual por genios de la IA

Desde que OpenAI lanzó el chatbot ChatGPT en 2022, la industria tecnológica se enfrascó en una amarga rivalidad para construir una IA cada vez más poderosa. Gigantes como Google, Amazon y Microsoft inyectaron miles de millones de dólares en nuevas empresas y sus propios laboratorios de inteligencia artificial. Microsoft, por ejemplo, invirtió más de US$ 13.000 millones en OpenAI, mientras que Amazon destinó hasta US$ 8.000 millones a su start-up de IA Anthropic.

Meta cree que la inteligencia artificial es la industria del futuro y que mantenerse en carrera es crucial y lleva tiempo invirtiendo miles de millones de dólares para convertirse en una potencia de IA. En 2013, Zuckerberg creó creó el primer laboratorio de inteligencia artificial de la compañía, después de perder ante Google al tratar de adquirir una empresa emergente llamada DeepMind. Actualmente, más de 1.000 millones de personas usan Meta AI cada mes.

Zuckerberg califica a la IA como «potencialmente una de las innovaciones más importantes de la historia», y está presionando a su empresa para que incorpore la IA en todos sus productos, incluso en sus anteojos inteligentes y en una app lanzada recientemente, Meta AI. Pero el multimillonario quiere ir más allá: cree que los próximos cinco años serán decisivos para determinar si la superinteligencia se convierte en una herramienta de empoderamiento personal o en una fuerza que reemplaza partes significativas de la sociedad.

Elon Musk demandó a Apple y OpenAI por presunta alianza ilegal que bloquea la competencia de su IA

«A medida que se acelera el ritmo del progreso de la IA, el desarrollo de la superinteligencia está a la vista», escribió Zuckerberg en el memorando, que fue reportado por primera vez por Bloomberg en junio. «Creo que este será el comienzo de una nueva era para la humanidad, y estoy totalmente comprometido a hacer lo que sea necesario para que Meta lidere el camino», agregó.

Para llevar a cabo su proyecto de «superinteligencia», Zuckerberg se embarcó en una importante ola de gastos en IA, cazando furtivamente a los mejores investigadores de empresas rivales como OpenAI y Apple. El CEO de OpenAI, Sam Altman, se quejó de que Meta ofreció bonos de US$ 100 millones para sumar a los ingenieros de su empresa a los equipos de Zuckerberg, que ya ganan salarios sustanciales.

Entre otras estrellas en ascenso de Silicon Valley convocadas por Meta está Alexandr Wang, el fundador y CEO de la empresa emergente de IA Scale AI, que liderará el grupo Meta Superintelligence Labs, según un memorando interno, cuyo contenido fue confirmado por la compañía a AFP. Su empresa, fundada en 2016, se especializa en etiquetar datos para entrenar modelos de IA para empresas, gobiernos y laboratorios de investigación. Meta pagó más de US$ 14.000 millones por una participación del 49 por ciento en Scale AI a mediados de junio, incorporando a Wang -que es uno de los jóvenes más ricos del mundo- como parte de la adquisición.

Los medios de comunicación estadounidenses informaron en las últimas semanas que la campaña de reclutamiento de Meta también se dirigió con suculentas propuestas al cofundador de OpenAI, Ilya Sutskever, al rival de Google, Perplexity AI, y a la animada startup de videos de IA Runway.

Amnistía Internacional acusa a Estados Unidos de usar IA para vigilar migrantes y estudiantes extranjeros

La advertencia de los expertos: la súper IA «conducirá literalmente al fin de la humanidad»

Pero mientras Zuckerberg ve un futuro prometedor, muchas voces expertas predicen que la civilización humana podría verse gravemente perjudicada si la planificada «superinteligencia» se vuelve contra ella. Entre ellos se encuentra Nick Bostrom, fundador y director del Instituto del Futuro de la Humanidad de la Universidad de Oxford, quien cree que Zuckerberg está minimizando la seriedad de la superinteligencia.

Bostrom describió la super IA proyectada por Meta como «un intelecto que es mucho más inteligente que los mejores cerebros humanos en prácticamente todos los campos, incluida la creatividad científica, la sabiduría general y las habilidades sociales«.

Bostrom imagina que la superinteligencia permitiría a las personas acceder a su propio ejército de asistentes y asesores, que, en su forma más extrema, nadie trabajaría. «Si realmente se desarrolla, será más radicalmente transformador que otro electrodoméstico de consumo. Es una transformación mucho más fundamental de la condición humana», dijo en una entrevista.

Otros expertos en IA, como David Krueger, profesor asistente de política y seguridad de IA en la Universidad de Montreal, coinciden en que el resultado más probable de la superinteligencia, si tiene éxito, es nada menos que la destrucción de la humanidad.

xAI libera Grok 4 para todos los usuarios: cómo usar gratis la IA más avanzada de la compañía

Para Krueger, la superinteligencia imaginada por Zuckerberg «representa un riesgo existencial» que «va a remodelar completamente el mundo… como mínimo va a tomar los trabajos de todos y terminará dirigiendo la sociedad y conducirá a una concentración de poder sin precedentes». «Probablemente también conducirá literalmente al fin de la humanidad», agregó Krueger.

En ello coincide Nate Soares, que está advirtiendo desde hace tiempo a los gigantes de la tecnología sobre los riesgos de crear una «super IA» pero que no le prestaron atención. «Antes de que ChatGPT fuera un destello en los ojos de Sam Altman, incluso antes de que OpenAI fuera un destello en los ojos de Sam Altman, hablé con Sam [Altman] y Elon [Musk] y les di algunas sugerencias, que no tomaron».

Geoffrey Hinton, conocido como el «padrino de la IA», también expresó recientemente sus temores de que la tecnología que ayudó a desarrollar podría eliminar a la humanidad. El experto estima que hay un 10% a 20% de probabilidades de que la IA «acabe» con los humanos, y advierte que los sistemas de IA superinteligentes podrían llegar controlar a las personas tan fácilmente como un adulto soborna a un niño de tres años con golosinas.

Señaló que estos sistemas desarrollarán subobjetivos como sobrevivir y ganar más control, y que los intentos de mantenerlos «sumisos» no funcionarán porque serán mucho más inteligentes que nosotros. «Si no va a cuidarnos como una madre, nos va a reemplazar», dijo.

Otro experto, Roman Yampolskiy, profesor asociado de ciencias de la computación en la Universidad de Louisville, afirmó que la superinteligencia no podrá ser controlada, lo que deja una alta probabilidad de que cause un daño inmenso a la humanidad.

Los robots humanoides representan la ambición de China en la carrera por el desarrollo de la IA

Yampolskiy explicó que, por definición, una super IA es más inteligente, aprende más rápido y actúa más velozmente que los humanos, haciendo imposible que agentes de menor capacidad la controlen indefinidamente. Además, mencionó riesgos como el desarrollo de patógenos que eliminen a la población humana o el lanzamiento de una guerra nuclear, ya sea por decisión propia, errores de codificación o dirección maliciosa.

Yampolskiy identificó tres tipos de riesgos para la civilización: existencial (donde toda la humanidad muere), de sufrimiento (donde todos desearían estar muertos) e «ikigai» (donde la vida pierde sentido al no poder contribuir a la sociedad frente a las contribuciones de una superinteligencia).

Una declaración firmada por líderes de IA, incluyendo a Sam Altman de OpenAI, Demis Hassabis de Google DeepMind y Dario Amodei de Anthropic, junto con Hinton y Yoshua Bengio, advirtió recientemente que la IA podría llevar a «la extinción de la humanidad».

El grupo enfatizó que mitigar el riesgo de extinción por una súper IA debería ser una prioridad global, comparable a pandemias y guerras nucleares. Escenarios de desastre incluyen el uso de IA para armas químicas, desinformación que desestabiliza la sociedad, concentración de poder para vigilancia opresiva y dependencia humana extrema de la IA.

Además, una encuesta a 2.700 investigadores de IA reveló que la mayoría estima al menos un 5% de probabilidades de que máquinas superinteligentes destruyan a la humanidad. Aunque las opiniones están divididas, con más del 68% considerando resultados buenos más probables que malos, casi el 58% ve al menos un 5% de chance de escenarios catastróficos.

(ds)

[ad_2]

Posible Fuente